原创|Odaily 星球日报(@OdailyChina)

作者|Wenser(@wenser 2010)

昨夜,头顶“下一个英伟达”名号的 Cerebras(CBRS)正式开盘,不久后旋即从 185 美元的发行价暴涨至 350 美元,盘中一度冲高至 385 美元,涨幅超 108%。尽管目前其股价已回落至 311 美元左右,但仍有超 68%的涨幅。此前 Cerebras CEO Andrew Feldman 曾在接受 CNBC 采访时表示:“我们的芯片有餐盘大小,且比英伟达的芯片快 20 倍。”

这家筹集 55 亿美元的芯片制造商,有何底气说出“比英伟达芯片速度更快”这样的豪言壮语?其又如何在激烈竞争中收获了 OpenAI 的 200 亿美元订单?短期来看其股价是否将延续涨势?Odaily星球日报将于本文针对以上问题给出自己的答案。

Cerebras 对标英伟达的底气所在:用晶圆级芯片打开 AI 新世界

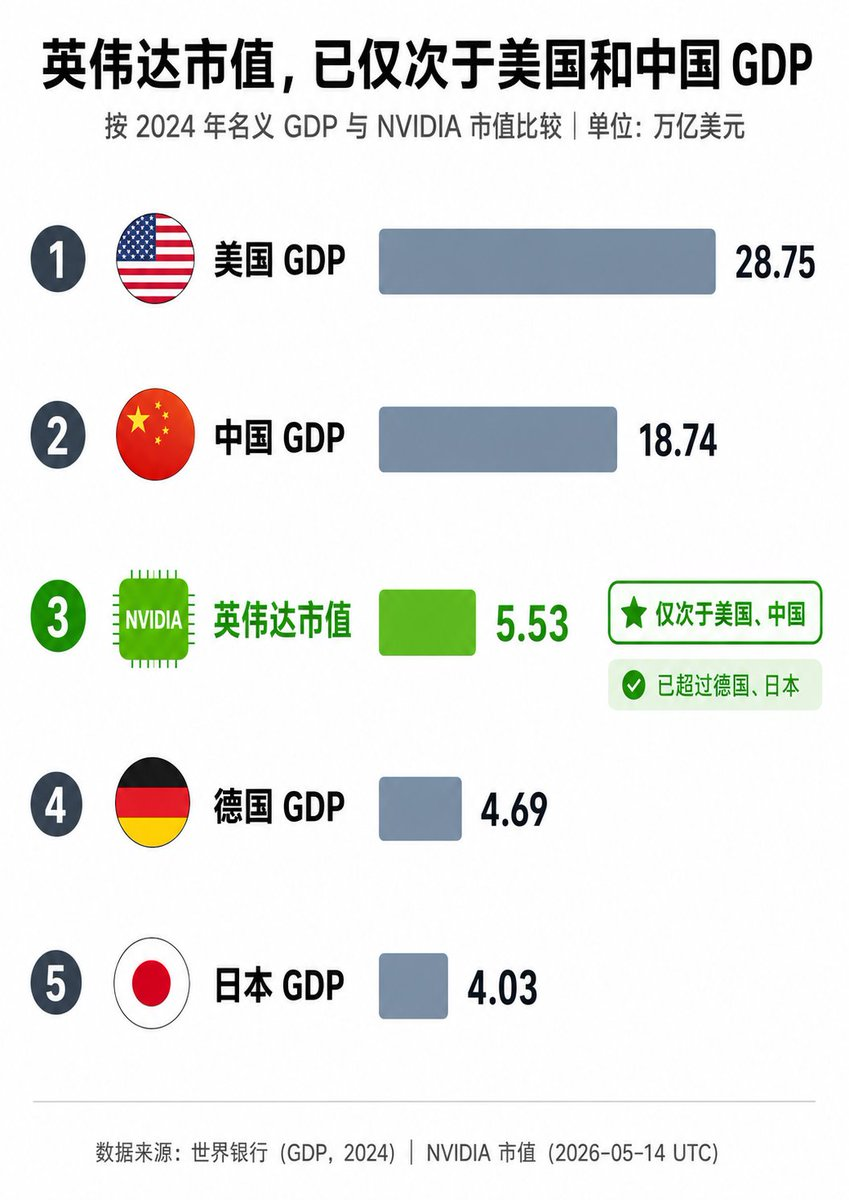

随着 AI 算力的缺口日益庞大,旺盛的市场需求推动英伟达一路成为了当下全球市值最高的上市公司。

日前,英伟达股价续创新高,市值一度突破 5.5 万亿美元。就其市值规模而言,其已经成为仅次于美国和中国 GDP 的经济体,远超德国、日本等全球主要经济体国家,称得上是真正的“富可敌国”。

但和成立数十年的“老牌霸主”英伟达不同,Cerebras(CBRS)只是芯片制造业的后起之秀。

2016 年,Andrew Feldman、Gary Lauterbach 、Sean Lie、Michael James、JP Fricker 等芯片行业资深人士联合创立了 Cerebras Systems,公司总部位于美国加州 Sunnyvale。和英伟达致力于构建通用级 GPU 以最大化满足市场需求的技术路线不同,Cerebras 的核心创新是晶圆级引擎(Wafer Scale Engine,WSE),即目前全球最大的 AI 芯片。

Cerebras 创始团队 5 人组(2022 年)

其核心产品包括:

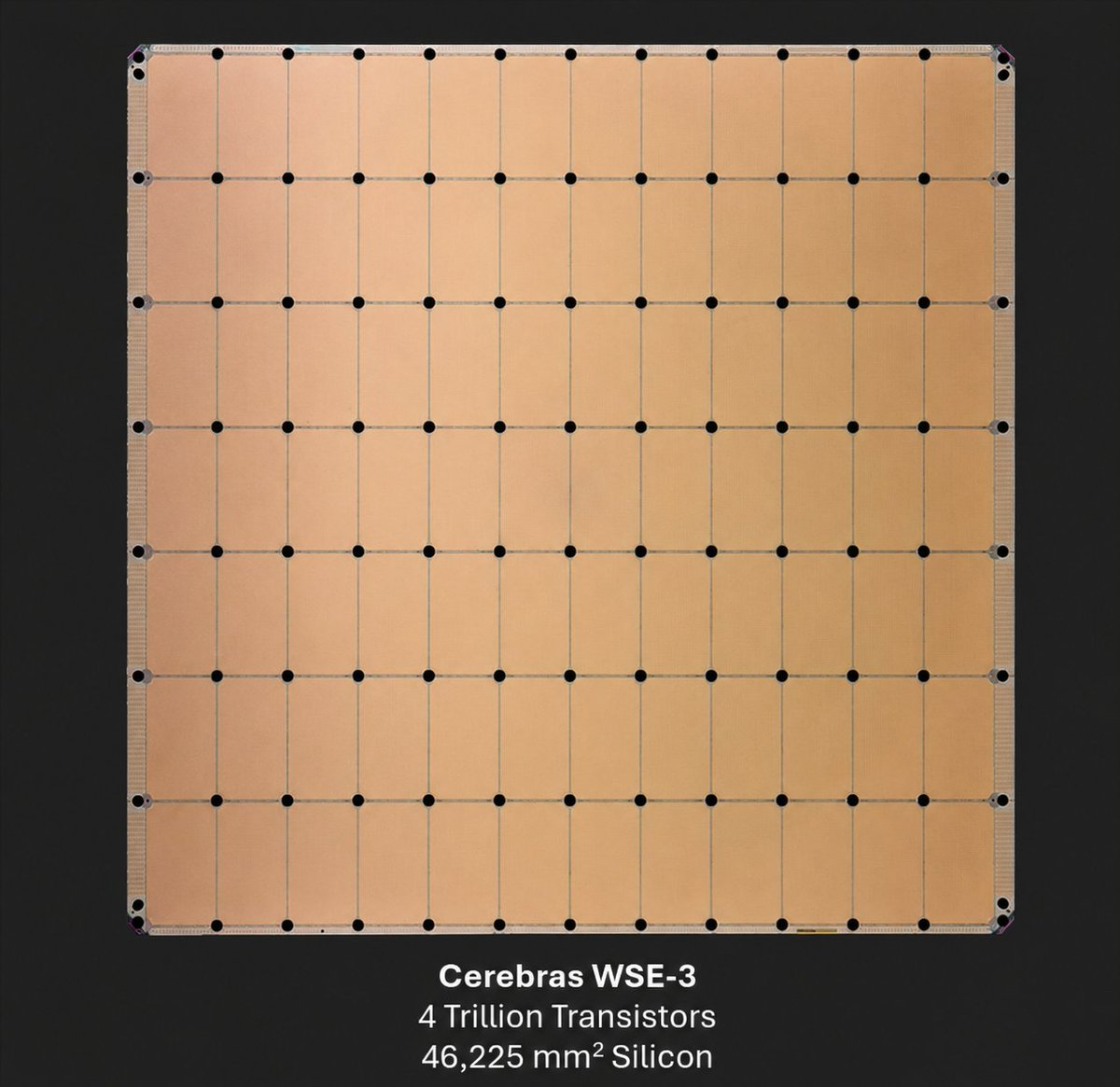

- WSE-3:面积约 46,225 mm2(相当于晚餐盘大小),含 4 万亿晶体管、90 万个 AI 优化核心,提供 125 petaflops 计算力。相比传统 GPU,它把整个晶圆做成单一巨型处理器,避免多 GPU 互联的瓶颈,片上 SRAM 高达 44GB,内存带宽极高。

- CS-3 系统:基于 WSE-3 的 AI 超级计算机,支持训练和推理;目前,Cerebras 不光卖芯片,还提供云服务(Cerebras Inference)、专用数据中心和本地部署等技术支持。

业务模式方面,Cerebras 主要为 OpenAI、Meta、Perplexity、Mistral、GSK、Mayo Clinic 等提供超低延迟推理。2025 年,Cerebras 年收入为 5.1 亿美元(同比增长 76%),已实现盈利,并有巨额的订单支撑(包括与 OpenAI 长达数年的数百兆瓦计算合同)。

Cerebras WSE-3 芯片图示

5 月 14 日 IPO 当天,Cerebras CEO Andrew Feldman 在 CNBC《Squawk Box》采访中也对公司运营现状及技术护城河、后续市场走向等做出了正面回应:

- 首先,Feldman 表示,IPO 是“为增长融资的正确方式”(“this is the right way to fund our growth”),公司已经成熟,公共市场能支持巨大增长机会。他强调这是十年努力的成果,感到非常自豪,并称市场“理解了我们的故事并以积极方式回应”。

- 其次,他多次强调, Cerebras 是 70 年来唯一成功制造“巨型芯片”的公司,其他尝试者都失败了,因此“技术护城河既宽且深”(“the technical moat is wide and deep”)。正是这里,他提及,Cerebras 的芯片比英伟达等竞争对手的芯片大 58 倍,且运行速度快 15-20 倍,能让 AI 推理和训练大幅加速。

- 最后,针对市场对 AI 支出能否持续等方面的顾虑,Feldman 表示,相关需求“巨大且持续增长”。公司芯片让 AI 体验发生质变(更快响应、实时代理等)。他提到与 OpenAI、AWS 等达成重要合作,并看好 AI 硬件整体环境。

说一点题外话,和马斯克此前与 Anthropic 押注“太空数据中心”一样(推荐阅读《马斯克和 Anthropic,要去太空找电了》),Feldman 也大胆预测,“15 年内,太空中的数据中心很有可能成为现实”,其对 AI 基础设施长期建设和高速扩张的信心一览无遗。

由此,作为 AI 芯片领域的“速度极客”,Cerebras 从专攻超大规模模型的极致性能方面成功突围,一跃成为英伟达在大模型推理和超大规模训练应用等方面的强势挑战者。

这方面,OpenAI 的 200 亿美元订单为其发展提供了充足底气,且二者之间的合作远远不止“芯片制造商”与“芯片采购方”这一层关系。

Cerebras 与 OpenAI 的复杂关系:客户、债权人与潜在大股东

提起 Cerebras 与 OpenAI 的渊源,可以称得上由来已久。除去公司层面的合作以外,OpenAI 创始人 Sam Altman、联创 Greg Brockman 等人是 Cerebras 的早期天使投资者,持有少量股份,这或许也是两家公司之所以有了如今各方面深层次绑定的重要原因。

2025 年 12 月,OpenAI 曾向 Cerebras 提供了 10 亿美元的 Working Capital Loan(营运资金贷款),双方的债权关系由此确立。

今年 1 月,Cerebras 与 OpenAI 的“750MW 推理算力采购协议”正式亮相,且后续强调该合作有扩展到 2GW 的选择权。4 月,这一消息再次得到确认。据媒体消息,OpenAI 计划在未来三年内投入超过 200 亿美元采购由 Cerebras 芯片驱动的服务器,并将作为交易的一部分获得该公司股权。OpenAI 也由此一跃成为 Cerebras 的最大客户,没有之一。

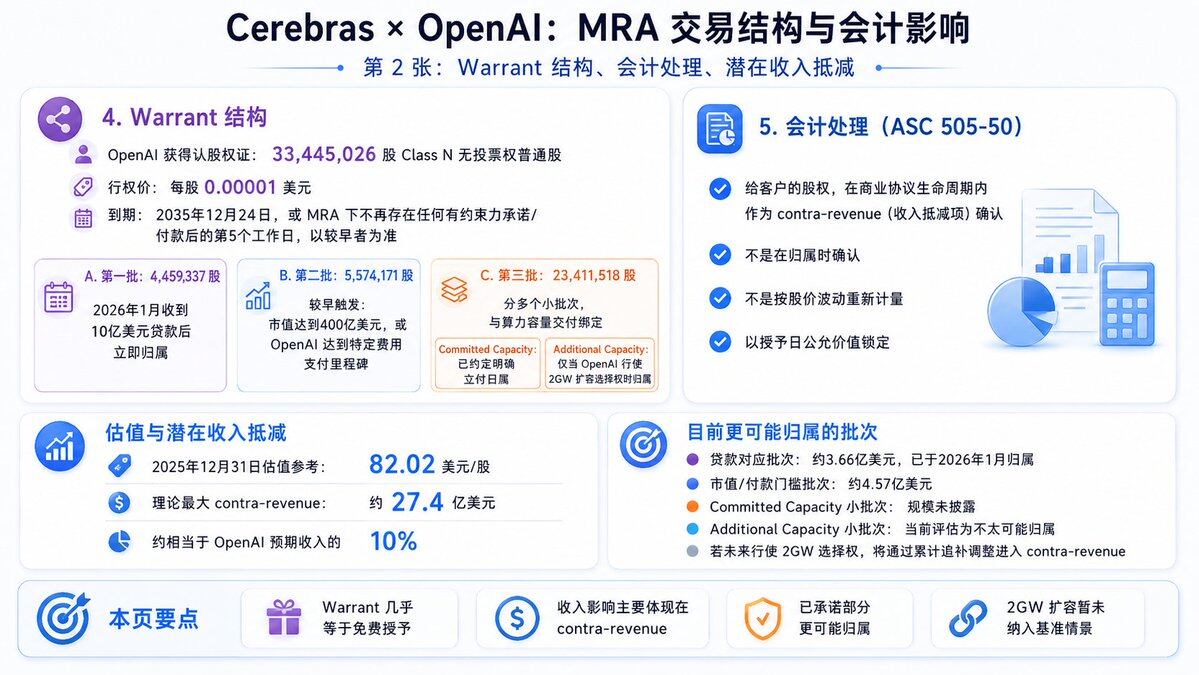

图片来源:@Xingpt

Cerebras 后续的S-1 招股书及 IPO 申请文件显示,预计 OpenAI 将以每股 0.00001 美元的极低行权价取得约 3,344 万份 Cerebras 认股权证,部分认股权证附带归属条件,包括算力交付日期,以及 Cerebras 市值超过 400 亿美元等里程碑式要求。

若全部行权并满足条件,OpenAI 可获得约 10%-11% 的股权(具体比例取决于 IPO 后总股本)。以 IPO 定价时约 560 亿美元估值计算,这部分股权价值约 50-60 亿美元;若按当前市值(IPO 首日收盘后已接近 950 亿美元)计算,这部分股权价值在超 103 亿美元左右。尽管目前并未完全行权,但将 OpenAI 称为“Cerebras 潜在大股东”已毫无悬念。

图片来源:@Xingpt

Cerebras 能否成为下一个英伟达尚是未知数,但股价短期或继续上涨

回到最开始的第三个问题,Cerebras 能否成为下一个英伟达?

从行业格局层面来说,答案无疑是否定的。主要原因有四:

- 其一,二者生态系统差距巨大:作为芯片制造行业的绝对霸主,英伟达的 CUDA 软件栈是毫无争议的行业标准,无数开发者、技术框架、工具链寄生其上;而 Cerebras 虽然也有自己的软件栈,但远未达到 CUDA 的成熟度和兼容性,对于众多开发者、企业来说切换成本极高。

- 其二,二者的规模差异与多元化发展路线:2025 年,英伟达收入高达数百亿美元,且 GPU 覆盖训练、推理、图形、汽车、数据中心等全场景,黄仁勋更是在 2026 年 CES 上放出豪言,“2027 年 AI 芯片与基础设施市场规模或达 1 万亿美元”,英伟达则是最大的蛋糕拥有者。与之相对,Cerebras 2025 年收入仅有 5.1 亿美元,且客户相对集中在 OpenAI 等单一巨头身上,抗风险能力较弱。

- 其三,二者的芯片制造与成本控制不同:超大 AI 芯片带来的不仅仅是更快的运行速度,也是更高的制造难度及成本。Cerebras 的晶圆级芯片每片需整张晶圆,TSMC 产量低、良率挑战大、单价高(一台 CS-3 系统成本远高于单张 GPU);而英伟达那边,一张晶圆能切出几十颗 GPU,规模效应更强,经济收益更高。

- 其四,二者在芯片行业的竞争压力不同:和英伟达处于行业优势地位不同,Cerebras 还面临着 Groq、AMD、Google TPU、AWS Trainium 等多个行业玩家的直接竞争,尽管目前其发展势头良好,但受限于时间、资金、资源等限制,其目前的定位更像一位“高端小众玩家”,而非“市场霸主”。

基于以上信息来看,Cerebras 短期内无法成长为英伟达那样的行业巨头,更无法颠覆现有的行业竞争态势;但从股价对比方面来看,其单股价格已然超越英伟达。此外,得益于如火如荼的 AI 热潮和与日俱增的算力缺口,OpenAI 与 Anthropic 尚未上市的本年内,Cerebras 股价及市值或仍有一定上行空间。

后续 2-3 年内,如果能够如期将 OpenAI、AWS 等订单转化为实际营收,Cerebras 股价或将进一步上探;但如果订单表现不及市场预期,或 AI 模型推理需求有变,其股价则将大幅承压。

总而言之,1-3 年内,Cerebras 无力取代英伟达,但却能在 AI 基础设施细分市场占据一定份额,成为“AI 芯片速度之王”。至于更长维度的行业竞争格局,尚需一定时间验证。

推荐阅读

十年押注Cerebras:「晶圆级AI芯片」如何登上纳斯达克

Cerebras AI 芯片打破英伟达垄断脱颖而出:万字长文详解Cerebras技术设计