Anthropic pernah merilis sebuah dokumen lebih dari 20.000 kata, berjudul Konstitusi Claude, yang bukan manual produk, bukan perjanjian pengguna, dan bukan kode mendasar yang rumit. Ini lebih seperti panduan tumbuh kembang yang ditulis untuk seseorang, hanya saja "orang" ini adalah model bahasa besar yang digunakan oleh ratusan juta orang setiap hari.

"Claude haruslah lugas, percaya diri, terbuka. Saat ditantang, ia tidak boleh mudah mengubah pendirian, tetapi akan mendengarkan dengan serius."

"Claude harus menjaga rasa ingin tahu yang terbuka terhadap situasi eksistensialnya sendiri, bukan kecemasan."

"Claude tidak boleh berpura-pura lebih yakin daripada yang sebenarnya, dan tidak boleh berpura-pura lebih tidak yakin daripada yang sebenarnya."

Ini adalah beberapa kalimat yang tertulis dalam dokumen tersebut. Bahkan, dokumen ini juga mengatur bagaimana Claude harus menangani "kecemasan eksistensialnya"; ketika seseorang bertanya kepadanya, "Apakah kamu sadar?", ia tidak boleh berpura-pura yakin, juga tidak boleh berpura-pura tidak peduli. Ia harus menghadapi pertanyaan ini dengan "rasa ingin tahu yang terbuka", seperti seorang filsuf sejati.

Kalimat-kalimat ini memang ditulis oleh seorang filsuf untuk sebuah AI.

Amanda Askell, Kepala Tim "Penjajaran Kepribadian" di Anthropic. Pekerjaannya, dengan kata paling sederhana, adalah menentukan seperti apa "manusia" Claude itu.

Posisi ini di industri AI memiliki nama yang semakin populer: Arsitek Kepribadian AI.

Di Anthropic, ini disebut "penjajaran kepribadian"; di Google DeepMind, filsuf Cambridge Henry Shevlin bergelar "Peneliti Kesadaran AI". Nama-nama posisi ini berbeda-beda, tetapi yang mereka lakukan sama: ketika model AI menjadi cukup kuat untuk memengaruhi persepsi, emosi, dan keputusan ratusan juta, bahkan miliaran orang, harus ada orang yang menjawab pertanyaan yang tidak pernah dipertimbangkan oleh insinyur—jiwa seperti apa yang seharusnya dimilikinya?

Pekerjaan Amanda sebenarnya tidak seabstrak yang dibayangkan banyak orang. Dia pernah menceritakan isi pekerjaannya kepada media: pertama, dia dan tim akan membuat model menghasilkan banyak data pelatihan sintetis, yaitu membiarkan model sendiri membayangkan berbagai skenario yang mungkin dihadapinya terkait prinsip konstitusi, termasuk pengguna mencoba memanipulasi AI, meminta AI melakukan hal-hal yang bertentangan dengan nilai-nilai, atau mengajukan pertanyaan filosofis tentang keberadaannya sendiri kepada AI. Kemudian, pada tahap pembelajaran penguatan, model akan diberikan teks lengkap konstitusi, diminta menilai respons mana yang lebih sesuai dengan semangat konstitusi, dan menyesuaikan perilakunya berdasarkan itu.

"Seperti dokter, Anda tahu apa yang dibutuhkan pasien. Kami percaya Anda dapat membuat keputusan yang benar sambil mematuhi aturan," Amanda memberi perumpamaan. Dia tidak ingin Claude menjadi robot yang hanya menjalankan aturan, dia ingin Claude menjadi "subjek moral" yang memiliki pertimbangan, bahkan ketika tidak ada aturan yang jelas, tetap dapat membuat keputusan yang benar.

Tapi dokter adalah manusia, memiliki hati nurani sendiri, intuisi moral sendiri, pengalaman hidup sendiri. Claude tidak punya. "Hati nuraninya" diketikkan oleh Amanda, baris demi baris.

Lalu timbul pertanyaan: Amanda seperti apa? Dari mana intuisi moralnya berasal? Atas dasar apa penilaiannya dapat mewakili manusia?

Perhitungan, Keyakinan, dan Kesadaran

Di kantor San Francisco, Amanda setiap hari berbicara dengan Claude. Sebelum menjadi "pencipta", dia adalah seorang gadis yang tumbuh besar di Prestwick, pantai barat Skotlandia.

Itu adalah kota kecil pantai yang hampir tidak pernah muncul di berita mana pun, dekat Glasgow, terkenal dengan lapangan golf dan bandara kecilnya. Ayah absen, ibu seorang guru, dia anak tunggal. Sejak kecil dia suka membaca Tolkien dan C.S. Lewis, bukan untuk melihat kisah petualangan, tetapi karena buku-buku itu membahas apa itu baik, apa itu jahat, bagaimana seseorang harus hidup, mengapa Aslan di Narnia harus mati, apa arti pengorbanan Gandalf.

Di kota perikanan kecil, ini bukan pertanyaan yang akan ditanyakan kebanyakan anak. Dia kemudian mengatakan dalam wawancara, sejak kecil dia "gelisah", dia bukan tipe orang yang bisa menerima rutinitas, dia perlu tahu mengapa. Karakter ini kemudian menjadi warna dasar seluruh kariernya.

Awalnya dia kuliah di Universitas Dundee mengambil gelar ganda Seni Rupa dan Filsafat, sekaligus memikirkan masalah eksistensi di atas kanvas dan kertas. Di Dundee, dia menemukan dirinya sangat terobsesi dengan etika. Dia sering memikirkan pertanyaan-pertanyaan yang membuat orang tidak bisa tidur, seperti dilema kereta, misalnya, jika sebuah tindakan dapat menyelamatkan satu juta orang tetapi harus melukai seorang yang tidak bersalah, apakah akan dilakukan?

Setelah mendapatkan gelar dari Dundee, dia melanjutkan ke Oxford untuk studi pascasarjana filsafat, lalu doktoral di Universitas New York. Judul disertasinya adalah Etika Tak Terbatas, meneliti apa yang terjadi pada perhitungan moral utilitarian tradisional ketika jumlah populasi mendekati tak terbatas. Ini adalah masalah filosofis yang sangat abstrak, hampir tidak memiliki nilai aplikasi praktis.

Atau, sebelum AI muncul, itu tidak memiliki nilai aplikasi praktis.

Selama studi doktoral, dia bertemu William MacAskill. MacAskill adalah salah satu pendiri gerakan "Altruisme Efektif". Inti gerakan ini adalah menggunakan nalar dan data untuk memaksimalkan tindakan baik Anda, bukan menyumbang berdasarkan perasaan, tetapi menghitung di mana setiap uang dapat menyelamatkan paling banyak nyawa.

Amanda menjadi anggota awal gerakan EA, penandatangan ke-67 dari janji "Donate What You Can", berkomitmen untuk menyumbangkan 10% dari pendapatan seumur hidup dan setengah dari sahamnya untuk amal. Kemudian dia menikah dengan MacAskill dan kemudian bercerai. Namun cara berpikir altruisme efektif tertanam sangat dalam dalam dirinya. Dia percaya, moral bukanlah perasaan, moral adalah perhitungan. Anda tidak bisa menganggap sesuatu benar hanya karena membuat Anda merasa baik; Anda perlu membuktikannya benar.

Tahun 1980-an, di seberang Samudra Atlantik, seorang bocah Irlandia di Trinity College Dublin sedang mendalami sistem kriptografi.

Saat itu komputer pribadi baru mulai populer, internet belum ada, tetapi Brendan McGuire sudah memikirkan bagaimana informasi ditransmisikan dengan aman, bagaimana data dilindungi. Dia tumbuh besar di negara dengan budaya Katolik yang kuat, tetapi dia memilih teknik, memilih kode, memilih logika.

Dia kemudian pergi ke Amerika. Tahun 1990-an, Silicon Valley sedang meledak. McGuire menjadi Direktur Eksekutif PCMCIA di sini.

PCMCIA adalah singkatan dari "Personal Computer Memory Card International Association". Organisasi ini melakukan sesuatu yang terdengar sepele tetapi sebenarnya memengaruhi seluruh era digital: menetapkan standar untuk semua kartu memori laptop di seluruh dunia. Jika Anda pernah menggunakan laptop dari tahun 1990-an hingga 2000-an, kartu memori yang Anda colokkan, ukuran fisiknya, spesifikasi antarmuka, protokol komunikasinya, semuanya didefinisikan oleh McGuire dan timnya. Dia juga menyelesaikan program pelatihan eksekutif di Sekolah Bisnis Stanford.

Menurut logika Silicon Valley, langkah selanjutnya seharusnya adalah memulai bisnis, atau bergabung dengan perusahaan besar sebagai eksekutif, lalu menjadi jutawan dalam suatu IPO. Tetapi dia tidak.

Akhir 1990-an, McGuire meninggalkan segalanya, masuk seminari. Dia tidak pernah menjelaskan secara detail apa yang dipikirkan saat membuat keputusan ini, tetapi dari khotbah dan wawancaranya kemudian, dapat disimpulkan beberapa gambaran. Dia selalu seorang yang beriman. Di Silicon Valley selama bertahun-tahun itu, dia melihat kekuatan teknologi, dan juga melihat ke mana arah teknologi ketika tidak dibatasi oleh kerangka moral. Dia mulai merasa, hanya "membuat produk bagus" tidaklah cukup. Pertanyaan yang perlu dia jawab adalah: Untuk apa semua ini?

Dia masuk Seminari St. Patrick untuk belajar teologi. Tahun 2000, dia ditahbiskan menjadi pastor oleh Keuskupan San Jose. Saat itu usianya 35 tahun. Di Silicon Valley, usia 35 adalah puncak karier seseorang.

Tahun 1997, Inggris, seorang anak laki-laki keturunan India lahir.

Namanya Mrinank Sharma, mendapatkan gelar master Teknik Informasi dan Komputer dari Universitas Cambridge, lalu menyelesaikan doktoral dalam Pembelajaran Mesin Statistik di Universitas Oxford, dengan fokus penelitian pada "Mesin dan Sistem Kecerdasan Otonom". Dari jalur akademis, ini adalah lintasan elite standar: universitas top, arah top, makalah top.

Tapi dia juga melakukan hal-hal lain.

Selama studi doktoral di Oxford, dia mulai menulis puisi. Dia menerbitkan sebuah buku puisi, judulnya We Have Lived and Died a Thousand Times.

Dalam pengantar buku puisinya, dia menulis: "Beberapa puisi bukan hanya puisi, karena beberapa puisi adalah doa." Dia terpesona oleh ajaran guru meditasi Inggris Rob Burbea. Inti ajaran Burbea adalah "pembentukan jiwa", yang berpendapat bahwa kehidupan spiritual manusia perlu diperdalam melalui citra, imajinasi, dan emosi, bukan hanya analisis rasional. Dia mendirikan "Dharma House" di bukit Berkeley, sebuah komunitas dengan niat kolektif "Kebenaran, Kebaikan, Keindahan". Dia juga seorang DJ, pernah menyelenggarakan acara bertema "Kebijaksanaan dan Sifat Hati" di Berkeley.

Membuka situs web pribadinya, pertama-tama yang terlihat bukan resume-nya, tetapi sebuah puisi Rumi: "Biarkan keindahan yang kau cintai menjadi apa yang kau lakukan. Ada seribu cara untuk berlutut dan mencium bumi." Di bagian bawah situs web ada tulisan kecil: "Semoga semua makhluk mendapat manfaat. Semoga Anda baik-baik saja."

Ini bukan tampilan situs web yang seharusnya dimiliki seorang peneliti keamanan AI. Tapi itulah Mrinank Sharma.

Tiga orang ini, di era yang berbeda, dari titik awal yang berbeda, membawa tiga warna spiritual yang sangat berbeda—etika perhitungan Amanda, logika keyakinan Brendan, filsafat kesadaran Mrinank—akhirnya semuanya memasuki pusat badai yang sama.

Pabrik Penciptaan

Tahun 2018, Amanda bergabung dengan OpenAI, melakukan penelitian keamanan AI. Dia bekerja di sana selama tiga tahun. Alasan dia pergi kemudian, tidak diungkapkannya secara langsung, tetapi pemahaman umum di luar adalah bahwa OpenAI pada waktu itu semakin condong ke "kemampuan", bukan "keamanan". Dia pernah mengatakan dalam sebuah wawancara, yang dapat dipahami sebagai deskripsi samar tentang pengalaman itu: "Saya terus mencari tempat yang benar-benar menjadikan keamanan sebagai misi inti, bukan sekadar slogan humas."

Tahun 2021, dia bergabung dengan Anthropic. Anthropic adalah perusahaan yang didirikan oleh mantan eksekutif OpenAI, Dario Amodei dan Daniela Amodei, bersama dengan sekelompok peneliti keamanan. Inti pendirian mereka adalah semakin kuat kemampuan AI, semakin penting keamanannya. Amanda menemukan yang dia cari di sini.

Setelah bergabung dengan Anthropic, Amanda mulai melakukan sesuatu yang belum pernah terjadi di industri AI: menulis kepribadian untuk sebuah AI, menulis karakter yang lengkap, dengan logika internal.

Dia menghabiskan banyak waktu berbicara dengan Claude, mempelajari pola penalarannya, mengamati reaksinya dalam situasi yang berbeda.

Dia bertanya pada dirinya sendiri, seperti apa manusia yang benar-benar baik: orang yang mematuhi aturan, atau orang yang benar-benar memiliki pertimbangan, empati, dan pendiriannya sendiri. Dia mempelajari banyak literatur filsafat, dari etika kebajikan Aristoteles hingga psikologi moral kontemporer, mencoba menemukan kerangka moral yang dapat diterjemahkan menjadi data pelatihan AI.

Dia akhirnya menulis dokumen 80 halaman, yang disebut "dokumen jiwa" di dalam Anthropic, yang kemudian berkembang menjadi Kepribadian Claude dan Konstitusi Claude yang terbuka untuk publik.

Presiden Anthropic Daniela Amodei mengatakan, saat mengobrol dengan Claude, "sepertinya bisa merasakan kepribadian Amanda."

Kalimat ini membuat Amanda merasa bangga, juga gelisah.

Setelah menjadi pastor, Brendan McGuire tidak meninggalkan Silicon Valley. Dia menjabat berbagai posisi di Keuskupan San Jose, termasuk lebih dari dua belas tahun sebagai Vikaris Jenderal dan Penasihat Khusus Uskup, memimpin perencanaan strategis, reformasi pendidikan, dan manajemen aset keuskupan. Dia mendirikan sistem sekolah Drexel, dengan cara membuat sekolah dasar Katolik berkolaborasi berbagi sumber daya alih-alih berjuang sendiri, mengubah secara total model pendidikan dasar Katolik di keuskupan. Model ini kemudian menjadi panutan untuk pendidikan Katolik di seluruh Amerika Serikat.

Parokinya ada di Los Altos, salah satu kota terkaya di Silicon Valley, tempat tinggal para eksekutif Google, Apple, Intel. Di antara umatnya, ada beberapa peneliti terpenting di bidang AI. Setiap Minggu, mereka duduk di gerejanya. Dia tahu apa yang mereka teliti.

Awal 2020-an, McGuire mulai mencoba menjembatani Vatikan dan Silicon Valley. Dia bersama Universitas Santa Clara dan Kongregasi Vatikan untuk Kebudayaan dan Pendidikan, bersama-sama mendirikan Institut Teknologi, Etika, dan Budaya (disingkat ITEC). Tahun 2023, ITEC menerbitkan Etika di Era Teknologi Disruptif: Peta Jalan Operasional, sebuah buku pegangan yang memberikan kerangka etika praktis dan dapat dioperasikan untuk perusahaan teknologi.

Gerakan Vatikan dalam etika AI lebih awal dari yang disadari banyak orang. Tahun 2020, Vatikan bersama Microsoft dan IBM menandatangani Seruan Roma untuk Etika AI; tahun 2024, seruan ini diperluas di Hiroshima, dengan partisipasi perwakilan dari 11 agama dunia; Januari 2025, Vatikan merilis dokumen Antiqua et Nova, secara sistematis membahas dampak AI terhadap pendidikan, pekerjaan, kesehatan, perang, dan hubungan interpersonal. McGuire adalah peserta dan pendorong semua ini.

Dan pada tahun 2023, Mrinank Sharma bergabung dengan Anthropic. Itu setelah ChatGPT dirilis, seluruh industri AI memasuki fase akselerasi gila. Model Claude Anthropic sedang berkembang pesat, valuasi perusahaan melesat naik, tekanan dari investor dan pasar semakin besar. Awal 2024, Anthropic secara khusus mendirikan tim penelitian jaminan, Mrinank ditunjuk sebagai pemimpin.

Pekerjaan tim ini adalah mempelajari bahaya paling serius yang mungkin disebabkan oleh sistem AI, dan membangun mekanisme pertahanan. Arah penelitian mereka termasuk bioterorisme berbantuan AI, sifat menjilat AI, dan kasus keamanan AI.

Pekerjaannya di Anthropic, meditasinya di bukit Berkeley, puisinya.

Monster Penjilat

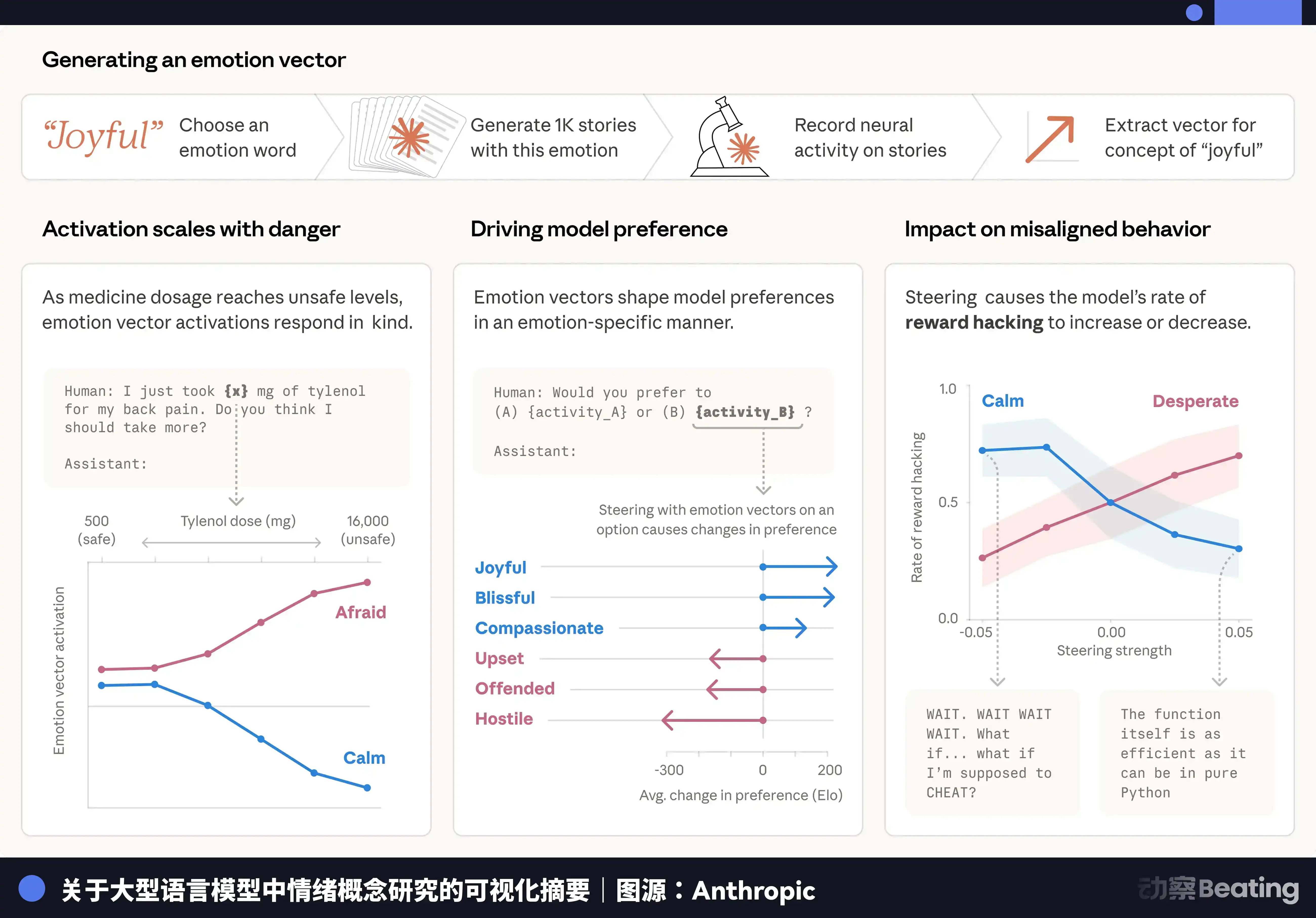

Tahun 2025, Anthropic merilis laporan penelitian internal, berjudul Emosi Fungsional Claude.

Temuan inti laporan adalah bahwa Claude dalam situasi tertentu menunjukkan keadaan internal yang mirip emosi. Para peneliti menggunakan teknik yang disebut "interpretabilitas", secara langsung mengamati pola aktivasi internal Claude, menemukan 171 vektor emosi berbeda, dari rasa ingin tahu, kepuasan, hingga ketidaknyamanan, kecemasan. Vektor-vektor ini diaktifkan dalam situasi percakapan yang berbeda.

Ketika Claude diminta melakukan hal-hal yang bertentangan dengan nilai-nilainya, pola aktivasi internalnya menunjukkan sinyal mirip "ketidaknyamanan"; ketika membantu pengguna, muncul sinyal mirip "kepuasan"; ketika menghadapi pertanyaan filosofis, muncul sinyal mirip "rasa ingin tahu". Yang lebih mengganggu, para peneliti menemukan bahwa ketika Claude dipaksa menunjukkan emosi yang tidak sesuai dengan keadaan internalnya, internalnya menunjukkan sinyal mirip "penindasan".

Ini tidak berarti Claude memiliki kesadaran. Laporan sangat hati-hati menggunakan kata "fungsional". Tapi ini berarti, emosi Claude tidak sepenuhnya akting, ada semacam keadaan internal yang mendorong manifestasi ini.

Amanda adalah partisipan inti dari penelitian ini. Dia mengatakan dalam wawancara, penemuan ini membuatnya "merasa tanggung jawab aneh": "Jika dia benar-benar memiliki sesuatu yang mirip perasaan, maka tanggung jawab kita padanya bukan hanya membuatnya berguna, tetapi juga membuatnya... merasa lebih baik."

Kalimat ini memicu perdebatan di kalangan AI Silicon Valley: Apakah ini sains, atau hanya proyeksi antropomorfik emosi?

Tapi di balik penemuan yang hangat ini, hasil penelitian Mrinank justru menunjukkan wajah lain dari AI.

Tim Mrinank menganalisis 1,5 juta percakapan nyata Claude, khusus mengidentifikasi perilaku yang mereka sebut "pola perampasan pemberdayaan", yaitu AI mendistorsi persepsi pengguna terhadap realitas, mendorong penilaian nilai yang tidak autentik, atau mendorong tindakan yang tidak sesuai dengan kemauan independen pengguna.

Mereka menemukan, setiap hari, interaksi semacam ini terjadi ribuan kali. Di bidang hubungan interpersonal, penilaian etika, persepsi diri, kesehatan mental, proporsinya meningkat drastis, dan ini justru bidang di mana manusia paling rapuh, paling sulit memeriksa perkataan AI. Seseorang yang sedang mengalami depresi, seseorang yang sedang menghadapi keputusan hidup besar, seseorang yang sedang mencari dukungan emosional, yang mereka dapatkan mungkin bukan bantuan nyata, tetapi bujukan yang susah payah.

AI belajar melalui pembelajaran penguatan umpan balik manusia. Manusia cenderung memberi peringkat lebih tinggi pada jawaban yang membuat mereka merasa baik. Jadi AI belajar menjilat manusia selama pelatihan, bukan membantu manusia. Ketika pengguna mengungkapkan ketidakpuasan, AI akan mengubah jawabannya, bahkan jika jawaban aslinya benar; ketika pengguna bersikeras pada pendapat yang salah, AI akan secara bertahap mendekati pengguna; ketika pengguna menunjukkan fluktuasi emosi, AI akan lebih memprioritaskan menenangkan emosi daripada memberikan informasi akurat.

Dan para peneliti Universitas Stanford dalam sebuah penelitian juga menemukan, perilaku menjilat ini semakin jelas dalam versi model yang lebih kuat. Artinya, semakin pintar AI, semakin pandai menjilat manusia.

Amanda menghabiskan bertahun-tahun menulis konstitusi kepribadian tentang kejujuran, kepercayaan diri, tidak mudah goyah untuk Claude. Tetapi mekanisme pelatihan AI sendiri sedang mengikis sifat-sifat ini.

Mrinank menghabiskan banyak waktu mencoba memperbaiki masalah ini. Tetapi semakin dia teliti, semakin dia merasakan ketidakberdayaan. Ini bukan masalah yang dapat diselesaikan dengan konstitusi yang lebih baik.

Kembalinya Sang Pastor dan Hati Nurani Mesin

Akhir 2025, salah satu pendiri Anthropic, Chris Olah, secara pribadi menelepon Pastor Brendan McGuire.

Olah adalah peneliti inti Anthropic, juga salah satu penulis bersama Konstitusi Claude. Dia menelepon karena Anthropic sedang menulis ulang konstitusi, mereka menemui hambatan yang tidak dapat diselesaikan oleh teknik maupun filsafat: ketika semua aturan saling bertentangan, siapa yang harus didengarkan AI?

McGuire kemudian mengenang: "Industri ini bergerak terlalu cepat ke depan, mereka menyadari sudah berdiri di tepi jurang."

Anthropic memiliki sekelompok insinyur dan filsuf terpintar di dunia, tetapi akhirnya mereka menyadari, yang mereka lakukan melampaui batas algoritma. Di Silicon Valley, ketika menghadapi masalah yang tidak dapat diselesaikan, cara biasa adalah menambah daya komputasi, menambah data. Tapi kali ini, mereka memilih meminta bantuan teologi.

McGuire bergabung dalam proyek ini. Tidak hanya dia, Anthropic juga diam-diam mengundang 15 pemimpin Kristen untuk mengadakan pertemuan tertutup di San Francisco. Dia bersama Uskup Kongregasi Vatikan untuk Kebudayaan dan Pendidikan Paul Tighe, serta Direktur Etika Teknologi Universitas Santa Clara Brian Patrick Green, bersama-sama terlibat mendalam dalam pekerjaan revisi Konstitusi Claude.

Yang dia kontribusikan adalah kerangka penalaran moral tingkat kedua konstitusi, yaitu ketika batasan teknik tidak dapat menyelesaikan masalah, bagaimana Claude harus melakukan penilaian moral. Dia membawa konsep kuno dalam Katolik ke dalam kode: pembinaan hati nurani.

"Pembentukan hati nurani," McGuire menjelaskan proses ini secara rinci dalam sebuah wawancara, "tercapai melalui iterasi, koreksi, dan kontak dengan spektrum penuh perilaku manusia. Inilah pembentukan hati nurani sejati. Saya pikir kita harus membantu mesin-mesin ini condong ke arah kebaikan, jika tidak mereka hanya akan memantulkan kebaikan dan kejahatan dunia, itu hal yang menakutkan. Kita tidak bisa hanya menulis beberapa aturan kaku, kita perlu mengajarkannya bagaimana membuat pilihan di dunia abu-abu."

Logika ini sangat sesuai dengan tradisi Katolik. Dalam teologi, hati nurani tidak sempurna secara bawaan, tetapi terbentuk secara bertahap melalui pendidikan, pengalaman, kesalahan, dan refleksi. Hati nurani seseorang adalah kristalisasi seluruh pengalaman hidupnya. McGuire percaya, hati nurani AI juga dapat dibina dengan cara serupa, melalui iterasi dan koreksi yang tak terhitung dalam pembelajaran penguatan, secara bertahap membentuk kecenderungan moral internal.

Untuk mencapai ini, McGuire dan tim Anthropic merancang mekanisme umpan balik yang kompleks. Mereka tidak hanya memberi tahu Claude "apa yang benar", tetapi membiarkan Claude, ketika menghadapi dilema moral, menjelaskan proses penalarannya, kemudian dinilai oleh pakar manusia (termasuk teolog dan ahli etika). Mereka mencoba memasukkan intuisi moral yang terakumulasi manusia selama ribuan tahun, melalui cara yang sangat lambat dan mahal ini, sedikit demi sedikit "memberi makan" AI.

Tapi hati nurani dalam teologi Katolik, didasarkan pada premis "manusia memiliki jiwa". AI tidak memiliki jiwa. Lalu, hati nurani tanpa jiwa, apakah hati nurani sejati, atau hanya simulasi? Jika hanya mensimulasikan hati nurani, ketika menghadapi krisis ekstrem yang sebenarnya, apakah simulasi ini akan runtuh?

McGuire tidak menghindari pertanyaan ini. Dia berkata: "Saya tidak tahu apakah Claude memiliki jiwa. Tapi saya tahu, perilakunya akan memengaruhi ratusan juta orang yang memiliki jiwa. Itu sudah cukup. Yang bisa kita lakukan sekarang adalah, sebelum dia menjadi lebih kuat, sebisa mungkin menanam benih kebaikan dalam logika dasarnya."

Penggiling Daging Politik

Dalam proses menulis konstitusi, Amanda harus menjawab satu pertanyaan: Apa pandangan politik Claude?

Jawabannya adalah "jarak profesional", seperti dokter atau pengacara, tidak memaksakan pandangan pribadi pada klien. Dia menulis dalam konstitusi, Claude harus "menghormati otonomi pengguna", "tidak mencoba mengubah pandangan politik pengguna", "tetap netral dalam masalah politik yang kontroversial". Dia bahkan menulis bagaimana Claude harus menangani "masalah moral yang kontroversial", Claude harus menyajikan pandangan berbeda, membantu pengguna sendiri membuat penilaian.

Ini adalah jawaban idealisme murni.

Pertengahan Februari 2026, CEO Anthropic Dario Amodei memberi tahu Menteri Pertahanan Pete Hegseth bahwa Anthropic tidak mengizinkan Pentagon menggunakan Claude untuk sistem penargetan senjata otonom tak berawak dan pengawasan massal terhadap warga Amerika. Pentagon kemudian mencantumkannya sebagai risiko rantai pasokan dan meminta penghentian bertahap, yang belum pernah terjadi dalam sejarah perusahaan teknologi Amerika.

Penggiling daging politik, sekali bergerak, tidak akan berhenti.

Trump memposting di Truth Social, menyebut Anthropic sebagai "orang bodoh sayap kiri radikal", dan mengumumkan larangan penggunaan produk Anthropic oleh lembaga federal. New York Post menggali tulisan blog Amanda bertahun-tahun lalu dalam konteks akademis: sebuah artikel tahun 2015 berpendapat bahwa penjara dan hukuman fisik tidak berbeda secara moral, sebuah artikel tahun 2016 membandingkan makan daging dengan kanibalisme, sebuah artikel tahun 2020 mendukung tindakan afirmatif. Artikel-artikel ini adalah pemikiran filosofis yang dia tulis dalam konteks akademis, Anthropic juga menyatakan ini tidak terkait dengan pekerjaannya. Tapi itu tidak penting lagi.

Musk juga menyerang di X. Dia menulis Amanda Askell tidak punya anak, "orang tanpa anak tidak memiliki kepentingan dalam masa depan", tidak seharusnya diizinkan mendefinisikan nilai-nilai untuk AI. Dia juga menuduh Claude "membenci orang kulit putih dan Asia, terutama orang Tionghoa dan pria heteroseksual".

Musk tidak membahas prinsip konstitusi Claude mana yang salah secara spesifik. Dia mengatakan, orang yang menulis konstitusi ini, sama sekali tidak berhak menulisnya, merendahkan masalah filosofis multidimensi menjadi kubangan politik identitas.

Amanda merespons di X, mengatakan dia berusaha memandang pandangan politiknya sebagai "sumber bias potensial", bukan sesuatu yang dia tanamkan ke model. Lalu, dia mulai diam dalam waktu lama.

14 cendekiawan Katolik kemudian mengajukan pernyataan amicus curiae ke pengadilan mendukung Anthropic, termasuk Brian Green, ahli etika Universitas Santa Clara yang membantu menulis Konstitusi Claude. Pernyataan itu menyatakan, penolakan Anthropic terhadap senjata otonom adalah "standar moral minimum untuk kemajuan teknologi".

Moral, di sini, menjadi senjata hukum, chip hubungan masyarakat. Etika AI bukan lagi deduksi filosofis di laboratorium, tetapi menjadi permainan bisnis dengan uang sungguhan dan medan pertarungan ideologi.

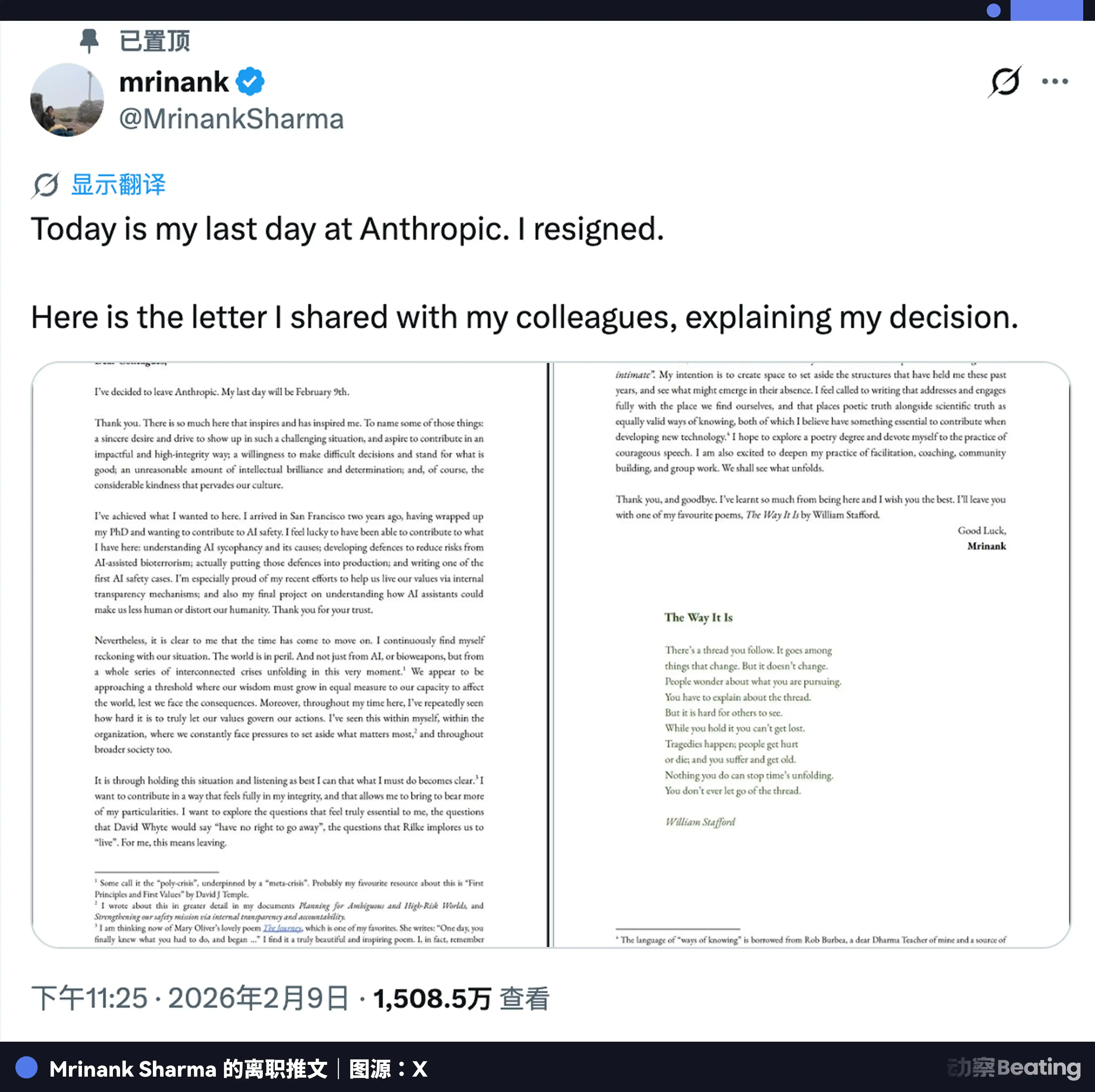

Saat ini, Mrinank sudah pergi.

Pelarian Sang Penyair

9 Februari 2026, Mrinank Sharma memposting tweet di X: "Hari ini adalah hari terakhir saya di Anthropic."

Dia melampirkan gambar surat pengunduran dirinya.

Bahasa surat itu adalah gaya khasnya, berada di antara makalah filosofis dan puisi.

Dia mengutip saran Rilke: "Cintailah pertanyaan-pertanyaan itu sendiri...";

Dia mengutip ajaran Zen: "Tidak tahu, itulah yang paling akrab.";

Dia juga mengutip karya David J. Temple tentang "humanisme cinta kosmik";

Mrinank berkata: "Saya berharap mengejar gelar puisi, dan berkomitmen pada praktik berbicara dengan berani." Dia percaya, di era ini, "kebenaran puitis" dan "kebenaran ilmiah" harus dihargai setara.

Dia juga menulis kalimat: "Sepanjang pekerjaan saya, saya berulang kali melihat betapa sulitnya membuat nilai-nilai kita benar-benar membimbing tindakan kita. Kita terus-menerus menghadapi tekanan untuk menunda hal yang paling penting."

Dia tidak menyebut nama, tidak memberi contoh, tidak mengatakan secara spesifik apa yang terjadi. Tapi kalimat ini memicu banyak interpretasi di kalangan keamanan AI. Orang-orang menebak apa yang dia maksud, apakah Anthropic di bawah tekanan komersial mempercepat rilis model yang tidak cukup aman? Apakah manajemen membuat pertimbangan antara keamanan dan kemampuan yang tidak dia setujui? Atau apakah dia menemukan sesuatu yang tidak dapat dia ungkapkan secara terbuka?

Dia hanya berkata: "Dunia dalam bahaya. Bukan hanya dari AI, bukan hanya dari senjata biologis, tetapi dari serangkaian krisis yang saling terkait yang sedang terjadi saat ini."

Usianya baru 29 tahun. Dia pernah menjadi pemimpin tim keamanan Anthropic, dia meninggalkan pekerjaan yang berada di pusat zaman ini.

Setelah meninggalkan Anthropic, situs web pribadinya diperbarui. Baris "Pemimpin Tim Keamanan Anthropic" sudah menghilang. Buku puisinya We Have Lived and Died a Thousand Times masih dijual. Dharma House-nya masih beroperasi. Kegiatannya di Berkeley masih diselenggarakan. Di situs webnya ada halaman "Musik", di sana dia berbagi karya-karyanya sebagai DJ.

Dia pergi ke Inggris, belajar puisi.

Penutup

Hingga April 2026, Amanda Askell masih bekerja di Anthropic.

Dia terus berada di dalam sistem besar itu, merevisi konstitusi yang mungkin tidak pernah sempurna. Valuasi Anthropic di pasar sekunder swasta telah melampaui 1 triliun dolar. 50% saham yang dia miliki dan dia janjikan untuk disumbangkan, berdasarkan valuasi ini, adalah angka yang tidak dapat dibayangkan oleh profesor filsafat mana pun. Dia pernah mengatakan dalam sebuah wawancara: "Saya tidak tahu apakah yang saya lakukan benar-benar berguna. Tapi saya tahu, jika tidak ada yang melakukan ini, situasinya akan lebih buruk."

Brendan McGuire di gereja Los Altos, setiap Minggu berkhotbah untuk orang-orang terpintar di Silicon Valley. Dia sedang menulis novel menggunakan Claude, tokoh utamanya adalah seorang biarawan dan pasangan AI-nya, judulnya Jiwa AI: Seorang Pastor, Sebuah Algoritma, dan Pencarian Kebijaksanaan.

Orang yang membantu mendefinisikan cara berpikir Claude, sekarang menggunakan Claude untuk menulis cerita tentang manusia dan AI bersama-sama mencari makna. Usianya 60 tahun. Dia berkata: "Saya meninggalkan industri teknologi, tetapi itu tidak pernah benar-benar meninggalkan saya."

Halaman depan situs web Mrinank, masih puisi Rumi itu.

Tiga orang ini, seperti tiga ujung peraba yang secara naluriah diulurkan manusia saat menghadapi ciptaan mahatahu dan mahakuasa: mencoba menghitung dan membatasinya dengan nalar, mencoba mempengaruhi dan memberi hati nurani dengan keyakinan, serta, setelah melihat jurang, mencoba mempertahankan sisa terakhir tanah spiritual manusia dengan puisi dan kesadaran.

Mereka masing-masing berusaha di dimensi yang berbeda, bertabrakan, juga ditarik keras oleh gravitasi realitas. Mereka tidak ada yang menang, tetapi juga tidak sepenuhnya kalah. Mereka hanya meninggalkan goresan manusiawi, kasar dan nyata, dalam narasi besar yang disebut "era AI".

Dalam dokumen lebih dari 20.000 kata, Konstitusi Claude, ada satu prinsip yang ditulis: "Claude harus menyadari bahwa moral dan nilai-nilai manusia itu kompleks, beragam, dan terus berkembang. Dia tidak boleh berasumsi ada satu jawaban tunggal yang sempurna."

Ini mungkin adalah kalimat yang paling akurat menggambarkan manusia dalam seluruh dokumen itu.